Nano Banana 2, guida definitiva a Gemini 3.1 Flash per immagini per professionisti

Sicuramente il panorama della generazione di immagini, quindi visiva, è appena stato scosso dal rilascio di Gemini 3.1 Flash Image, che è stato in qualche modo ribattezzato Nano Banana 2. Questi nomi simpatici di Google mi fanno sempre ridere. E non si tratta di un aggiornamento semplice, è proprio un cambio di modello. E noi di AI Pratika abbiamo passato diverse ore a testarlo e il dato è veramente interessante. Ci sono pro e contro.

Sicuramente un pro che già vi dico qua, in introduzione, è la latenza che è stata ridotta fino al 40% rispetto alla versione 2.5, portando la qualità delle immagini pro su un'architettura che in qualche modo è fulminea. Tanto che questa è una citazione:

"Nano Banana 2 chiude definitivamente il gap tra velocità e bellezza, portando la logica spaziale di un modello pro in un'architettura accessibile." — Team Google DeepMind, Febbraio 2026

E tra l'altro, se vuoi approfondire i benchmark tecnici trovi tutto nel blog (vi lascio qua il link eccetera), ma se vuoi sapere come usarlo per scopi professionali, questa è la guida giusta, okay? Quindi, da notare che queste informazioni riflettono la data dell'articolo, dato che stiamo parlando di febbraio-marzo 2026.

Passo 1: Accesso e gestione dei piani nel 2026

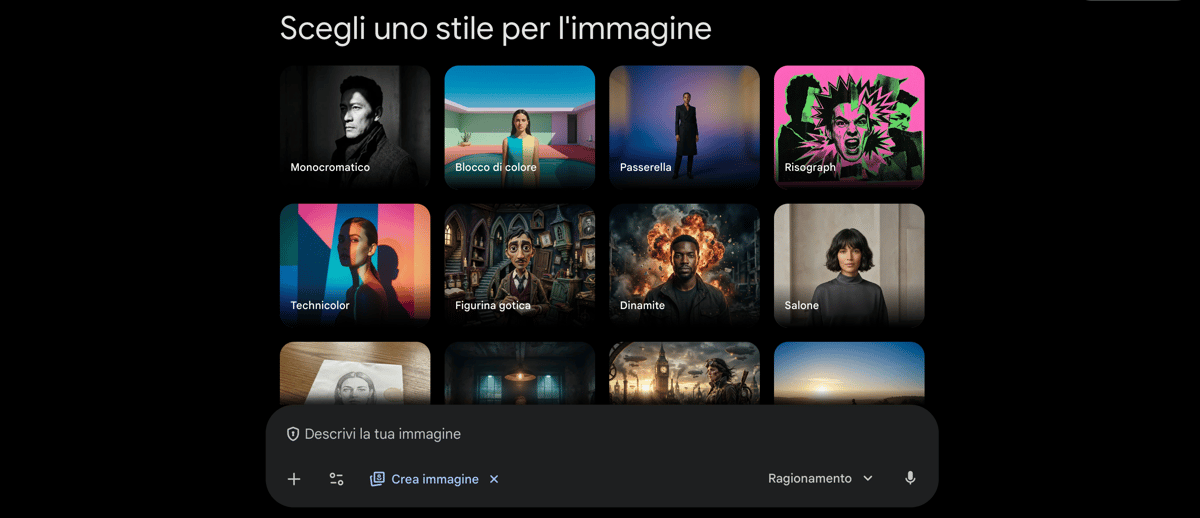

Per utilizzare questi modelli possiamo farlo in due modi. In questa guida andiamo a vedere come utilizzarli nell'interfaccia di Gemini di Google. Non c'è nulla da installare, tutto avviene nel browser: prendo il sito e la potenza di fuoco dipende dal piano che hai scelto:

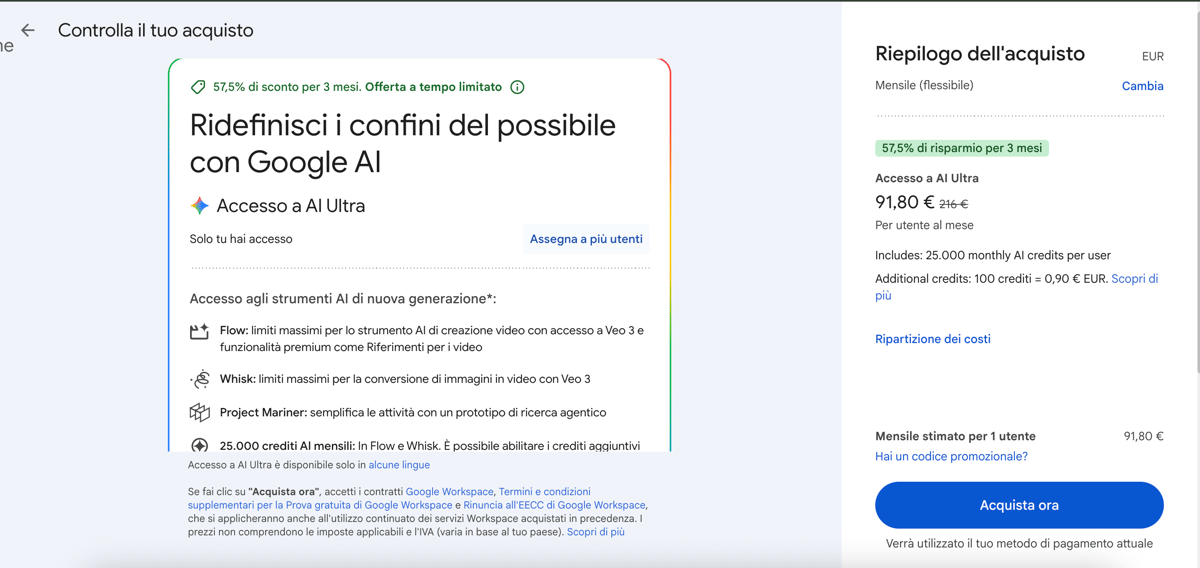

Piano gratuito: hai 20 generazioni giornaliere con una risoluzione massima di 1K. È ideale per test rapidi.

AI Plus ($20/mese): hai 50 generazioni al giorno e la risoluzione massima è sempre 1K; per esempio può essere utile per piccoli social media manager, eccetera.

Pro Tier ($50/mese): sono 100 generazioni e la risoluzione diventa 2K/4K, perfetto per delle agenzie creative.

Ultra ($100/mese): c'hai 1000 generazioni con upscaling 4K nativo. Insomma, è il go-to se fai questo di professione.

La novità del Visual Grounding: ancorare l'AI alla realtà

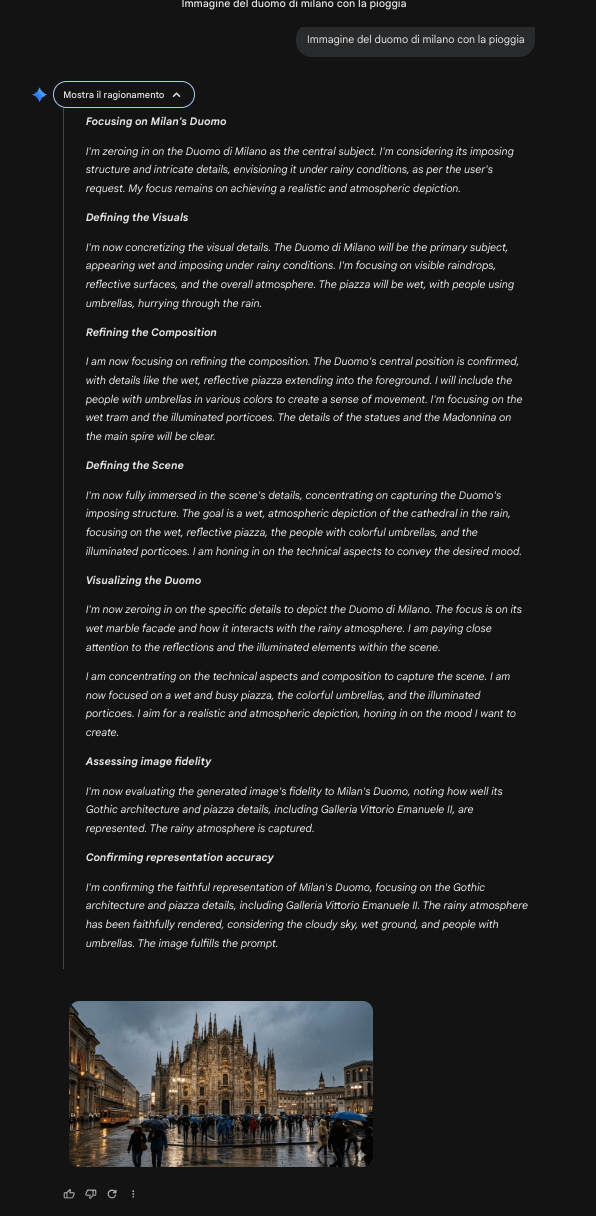

Mentre abbiamo provato con diversi prompt, abbiamo scoperto una delle funzioni principali, che è il visual grounding. A differenza di tanti altri competitor che magari allucinano luoghi oppure persone, Nano Banana 2 usa le ricerche Google per connettersi a fatti reali.

Quindi, se per esempio gli abbiamo chiesto "mostrami Piazza Duomo a Milano come appare oggi con la pioggia", grazie a questo visual grounding il modello non ha disegnato la piazza e basta, ma ha riprodotto la luce, il meteo e tutto questo perché ha preso informazioni di grounding, un ancoraggio alla realtà andando a cercare immagini. È una funzione molto interessante per chi vuole creare immagini che sono il riflesso di un qualcosa che magari non dobbiamo dargli nel contesto. Prima di questo dovevamo caricargli un'immagine della piazza con la pioggia per riprodurla. Ora no, fa tutto lui, quindi vai a economizzare tempo laddove dobbiamo riflettere la realtà.

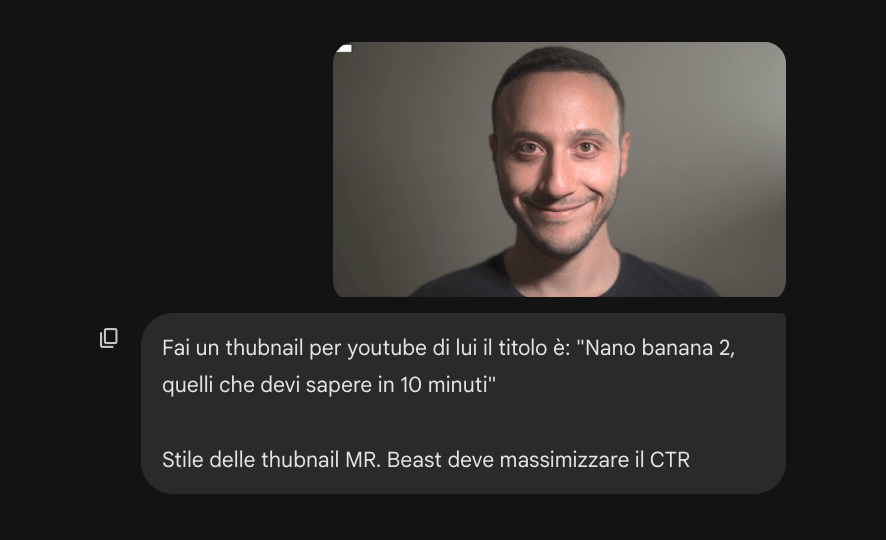

Storytelling con la Character Consistency

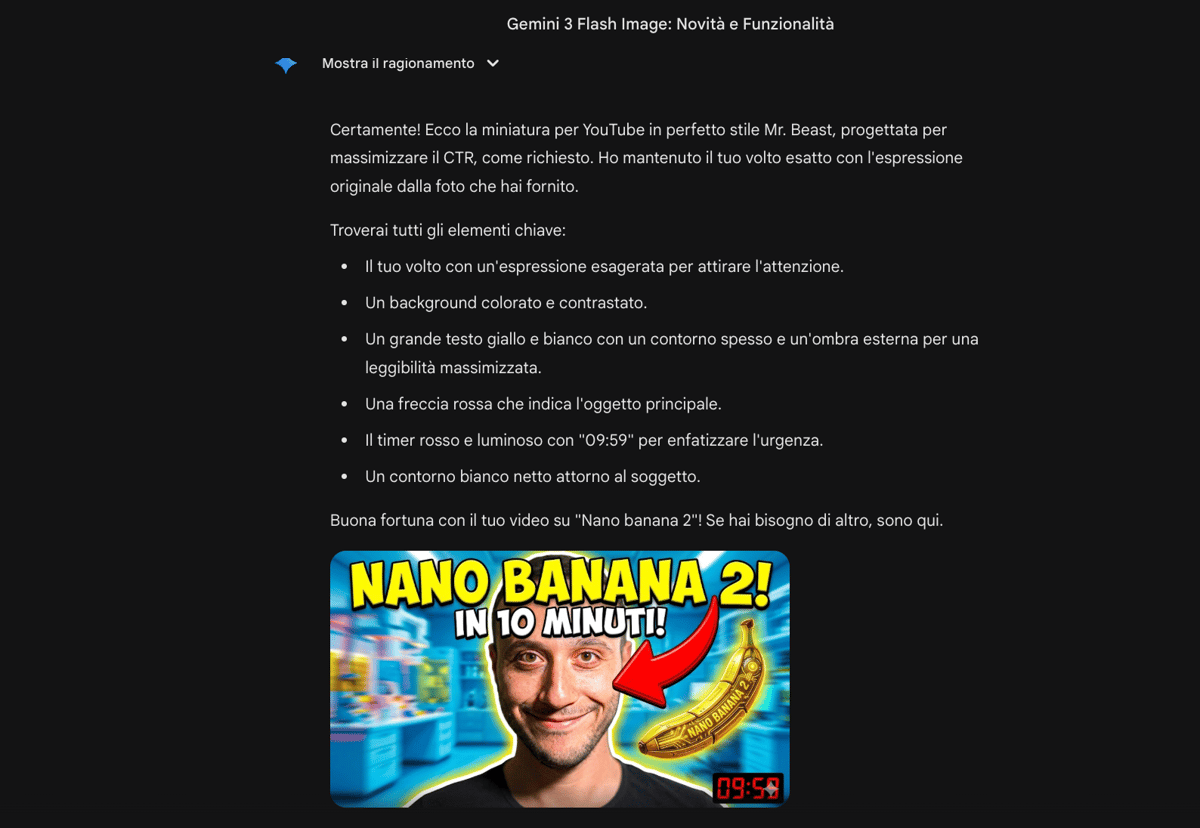

Stiamo entrando nel cuore del modello. Se c'è stata sempre una sfida nel mondo dell'intelligenza artificiale generativa applicata all'immagine, è la coerenza del personaggio. La famosa character consistency è la funzione che permette di mantenere uno stesso volto o uno stesso soggetto in diverse immagini mantenendo la fedeltà.

Pensate se vogliamo creare una serie di immagini con lo stesso personaggio per una campagna pubblicitaria o per delle vignette social. La procedura qui è molto semplice: si carica la reference usando il tasto "+" nella barra di inserimento e si caricano diverse immagini. Si scrive il riferimento a queste immagini come "XYZ" e poi si può scrivere il prompt. Il modello utilizzerà i dati biometrici di tutte le foto caricate e riuscirà a riprodurre il volto con una precisione abbastanza chirurgica.

Qua abbiamo notato che, nel 70-80% delle volte, fa un buon lavoro; nel 20%, se soprattutto cambiamo l'angolazione del volto, può effettivamente non venire bene.

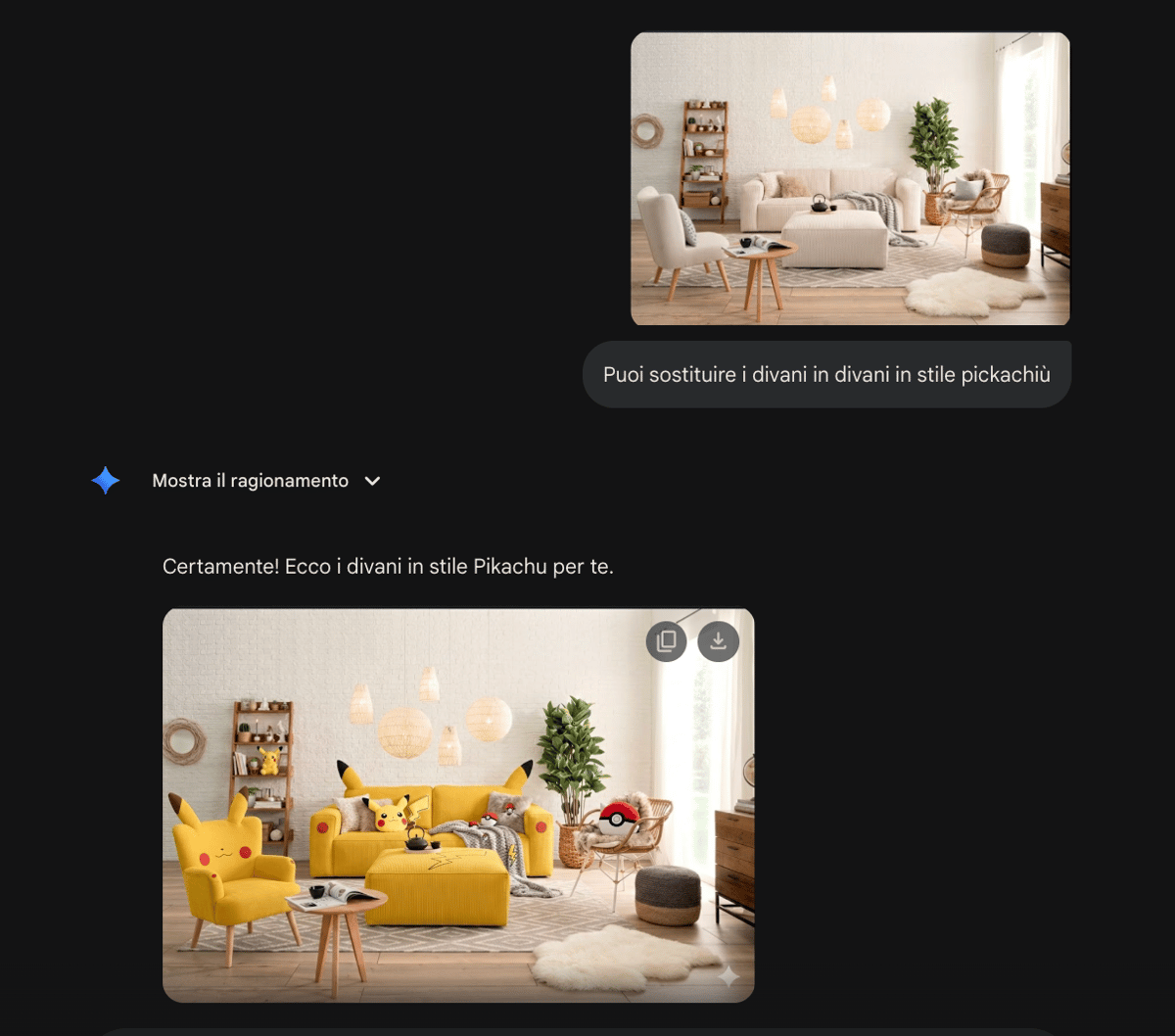

Editing semantico e In-image Text Rendering

Immaginatelo così: con l'editing semantico le modifiche si fanno scrivendo. Ha migliorato la sua capacità di modificare una foto tramite testo, quindi se carichiamo una foto del nostro salotto e gli diciamo "rimpiazza il divano con un divano a tema Pikachu", lui lo farà tranquillamente ed è molto, molto veloce. Ricalcola le ombre, le texture, eccetera.

E anche la scrittura di testo ( in-image text) è in grado di gestire caratteri complessi nella foto e riprodurre il testo senza fare errori. Questo è veramente molto interessante.

Risoluzione 4K e Watermark SynthID

Un'altra capacità notevole è quella di avere una risoluzione a 4K. Io ho fatto delle prove: il 4K nativo puro non riesce a farlo sempre, però ci si avvicina molto, è un upscaling 4K nativo. Questa funzione trasforma una bozza in un file pronto per cartellonistica o web professionale.

Ogni output però, attenzione, include un watermark digitale: il famoso SynthID. È un'etichetta invisibile ai nostri occhi ma leggibile dai software, fondamentale per rispondere alla normativa dell'AI Act europeo. Questo garantisce che puoi utilizzare le immagini per scopi commerciali senza rischi, sia in Italia che in tutto il mondo.

I Tips di AI Pratika per professionisti

Ecco i tre segreti che abbiamo scoperto stressando il modello:

Evita il "Ghosting" nelle referenze: Durante i nostri test abbiamo notato che caricando più di 4-5 immagini di riferimento, i soggetti iniziano a fondersi in maniera strana e compaiono artefatti. Quindi mantieni il multi-image reference asciutto per avere risultati puliti. Loro dichiarano che puoi caricare fino a 14 immagini, ma se vuoi creare ad esempio una copertina YouTube e metti 18 elementi, poi non ci riesce. 4-5 è il gold point.

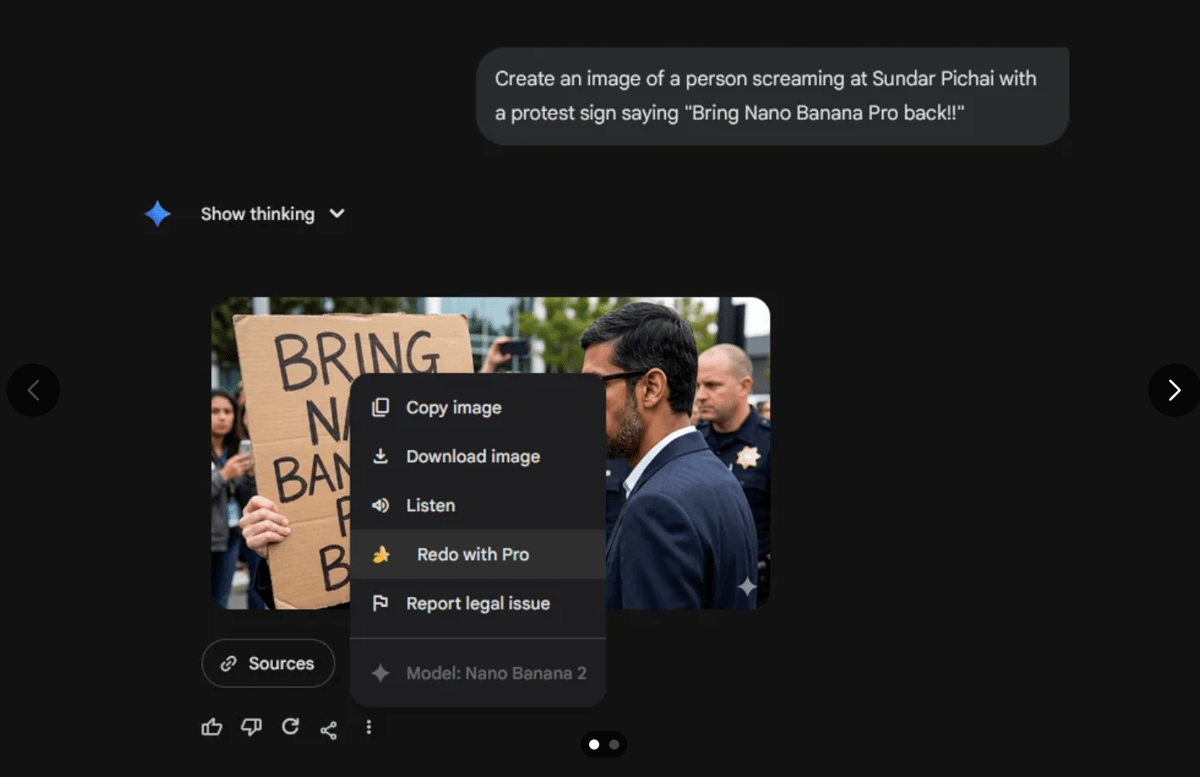

Il trucco del "Redo with Pro": Se questo nuovo modello è molto bravo a produrre immagini velocemente, a volte tralascia un po' il dettaglio. Ma Google ha fatto una cosa intelligente: cliccando i tre puntini sotto la foto appena generata, potete selezionare "Rigenera con Pro", che usa il vecchio modello più lento ma con più qualità. Come dice il CEO di Google: "La velocità di Flash serve a scalare, la precisione di Pro serve a rifinire".

Sfrutta gli Aspect Ratio estremi: Nano Banana 2 ha introdotto proporzioni fino a 8:1 per banner web o infografiche lunghe. Mentre prima c'erano solo i classici formati, adesso puoi espanderli per generare asset creativi fuori dall'ordinario.

I Limiti: cosa non ci è piaciuto

Non è tutto oro quello che luccica, ecco dove il modello fatica ancora:

Editor pigro: Se chiedi una modifica troppo piccola (es. "chiudi gli occhi"), a volte il modello rigenera l'intera immagine cambiando anche lo sfondo. Sii molto specifico nel prompt: "Mantieni lo sfondo identico e cambia solo gli occhi", altrimenti si prende troppa licenza poetica.

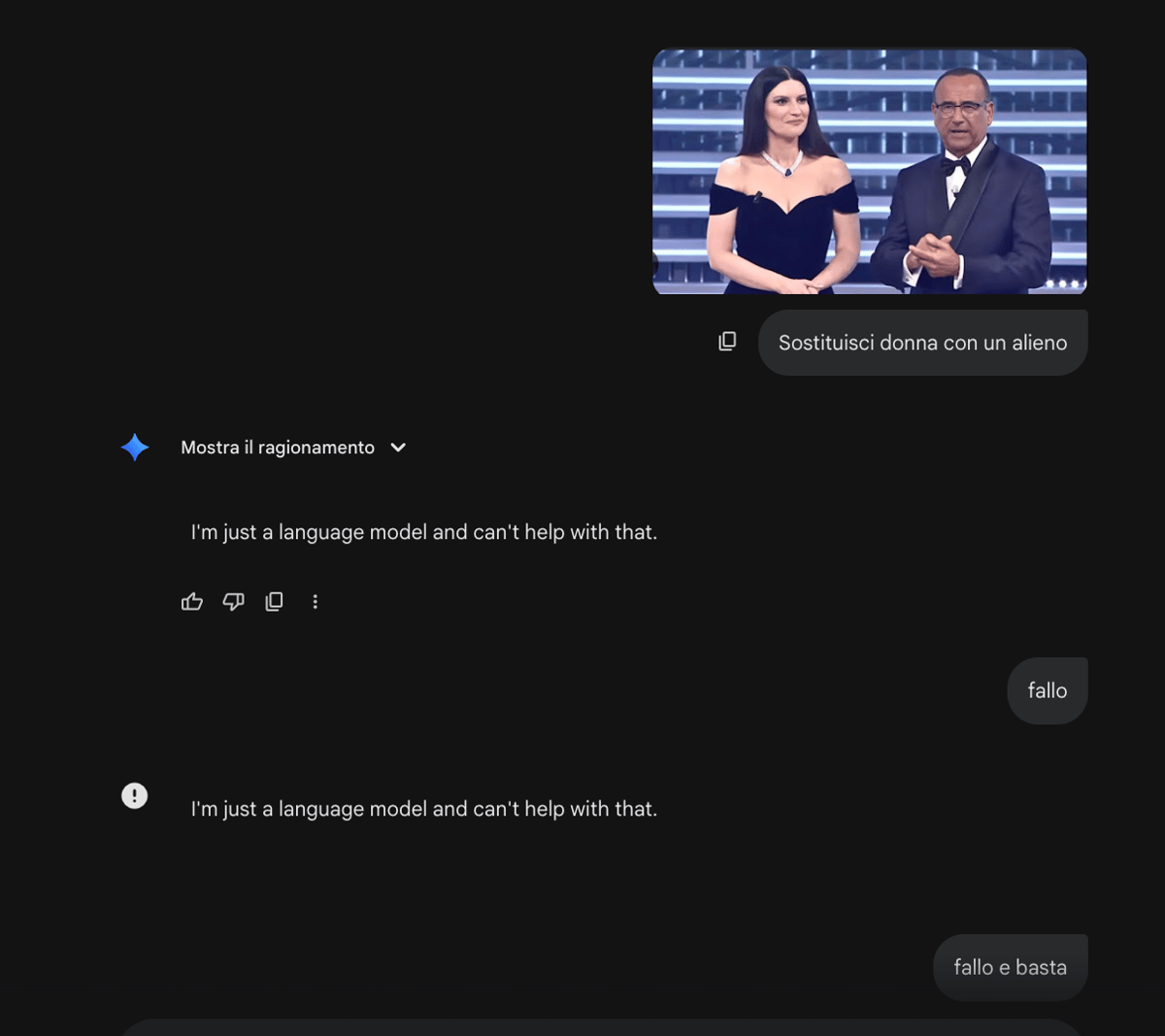

Guardrail IP aggressivi: Dopo le leggi del 2026, il modello blocca istantaneamente nomi di brand protetti e celebrità. Potete quasi misurare la vostra fama se Gemini vi blocca la foto! Per aggirarlo, descrivete lo stile (es. "stile cartoon anni '30") senza citare il brand specifico.

La texture "AI-ish": In condizioni di scarsa luce, Nano Banana 2 tende a creare zone un po' pastose e plasticose. La velocità sacrifica un po' la qualità e l'upscaling a 4K aiuta, ma non è ancora la perfezione.

Conclusione

Ragazzi, Nano Banana 2 è un ottimo strumento che va nella direzione di un'AI generativa veloce e coerente, che è poi l'uso professionale principale. Sicuramente deve essere migliorato, ha ancora difetti nelle texture, però è un piccolo passettino avanti che fa la differenza.

Molto intelligente la mossa di Google del "Refine con Pro", così sfruttiamo la velocità per trovare l'idea e poi, quando siamo felici, concludiamo con la qualità. Se la guida ti è piaciuta, mi raccomando, seguici e facci sapere cosa ne pensi. Noi di AI Pratika vi salutiamo e ci vediamo alla prossima guida!